O Que é Tráfego Orgânico no Google e quanto custa um profissional?

fevereiro 18, 2026

Google Search Central Live São Paulo 2026

fevereiro 25, 2026Google Search Central, apresento uma avaliação aprofundada do projeto Guia de SEO para iniciantes: princípios básicos.

Este documento não é apenas um tutorial técnico; é o manual de conduta oficial do Google e representa a espinha dorsal de como a empresa deseja que a web seja construída. Abaixo, detalho os eixos estratégicos, estruturais e técnicos deste projeto:

1. Visão Geral e Objetivo do Projeto

O guia tem como principal objetivo desmistificar o SEO (Otimização para Motores de Pesquisa). Ao longo dos anos, o SEO ganhou a reputação de ser um conjunto de truques (Black Hat) para enganar os algoritmos. O projeto do Google atua exatamente para combater essa ideia, educando webmasters, programadores e profissionais de marketing a construírem sites que priorizem a experiência do utilizador humano, facilitando o trabalho dos robôs (rastreadores) apenas como consequência.

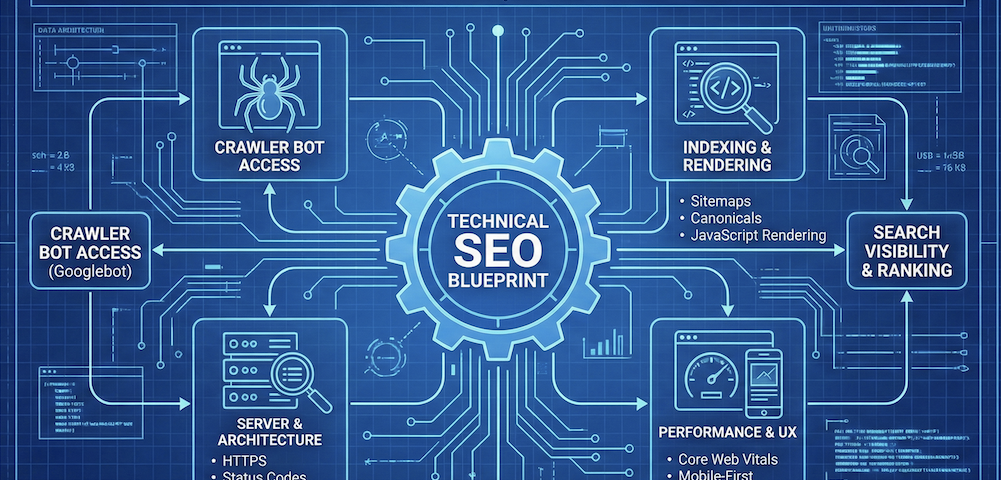

2. Os 4 Pilares Estratégicos

A estrutura da página foi desenhada para guiar o utilizador desde a fundação técnica até à promoção do conteúdo. O projeto divide-se em quatro pilares fundamentais:

Pilar Técnico (Descoberta e Indexação): O guia ensina a verificar a saúde básica do projeto (usando o comando `site:`) e explica que não basta publicar; é preciso ter uma arquitetura de links clara para que o Googlebot consiga rastrear a página. Aborda a importância de URLs lógicos e diretórios bem organizados.

Pilar de Conteúdo (Foco no Utilizador): Há uma forte ênfase em antecipar a intenção de busca. O projeto orienta os criadores a pensarem na linguagem do seu público-alvo (ex: leigos vs. especialistas) e a criarem conteúdos exclusivos e atualizados. O Google condena explicitamente anúncios intrusivos (intersticiais) que prejudiquem a leitura.

Pilar de Apresentação (Aparência na SERP): O guia detalha como controlar a montra do site nos resultados de pesquisa. Isso é feito através da otimização das tags `<title>` (links de título azuis) e das metadescrições (snippets). O objetivo aqui é otimizar a taxa de cliques (CTR) de forma honesta.

Pilar Multimédia: Reconhecendo a ascensão da pesquisa visual, o projeto dedica uma secção inteira a imagens e vídeos, exigindo o uso de texto alternativo (`alt text`) descritivo e imagens de alta qualidade próximas ao texto de contexto.

3. A Desmistificação de Práticas Obsoletas (O que NÃO fazer)

Uma das secções mais analíticas e valiosas do projeto é a parte de Dicas sobre o que evitar. O Google utiliza este espaço para matar mitos antigos da indústria de SEO que apenas geram spam na web. O guia decreta oficialmente que:

A tag Meta Keywords está morta: O Google não a utiliza para efeitos de classificação.

Keyword Stuffing é penalizado: Repetir palavras-chave de forma artificial não funciona e viola as políticas anti-spam.

Domínios de Correspondência Exata (EMD): Comprar um domínio apenas porque contém a palavra-chave (ex: `comprar-sapatos-baratos.com`) não garante melhor classificação e deve ser evitado se prejudicar a construção da marca.

4. Tom de Voz e Abordagem Pedagógica

O tom do documento é notavelmente transparente, cauteloso e realista. O Google gere as expectativas logo no início do projeto, afirmando que:

1. Não existem segredos para o primeiro lugar.

2. Nenhuma alteração de SEO tem efeito imediato (os resultados podem demorar semanas ou meses).

3. A promoção orgânica (boca a boca, redes sociais e engajamento comunitário) é incentivada, mas o excesso de promoção pode ser visto como manipulação.

O Google deixa claro desde o início duas premissas importantes:

A Pesquisa é um processo totalmente automatizado.

O Google não aceita pagamentos para rastrear sites com mais frequência ou para lhes atribuir uma classificação orgânica mais alta. Qualquer alegação contrária é falsa. Além disso, seguir as diretrizes não garante indexação ou exibição nos resultados.

2. Os 3 Estágios da Pesquisa Google

A documentação divide o funcionamento do motor de busca em três fases cruciais e consecutivas. É explicitado que nem todas as páginas passam por todas as fases.

Estágio 1: Rastreamento (Crawling)

Como não existe um registo central de todas as páginas da Internet, o Google precisa de descobrir URLs constantemente.

A Descoberta: O Google encontra novas páginas seguindo links de páginas já conhecidas ou através de sitemaps (mapas de sites) enviados pelos proprietários.

O Googlebot: O programa responsável pelo rastreamento é o Googlebot (também chamado de rastreador ou spider). Ele usa algoritmos para determinar o que rastrear e com que frequência. O bot é programado para não sobrecarregar os servidores dos sites; se o site devolver muitos erros HTTP 500, o rastreamento diminui.

Renderização: Durante esta fase, o Google usa uma versão recente do Chrome para renderizar a página e executar o JavaScript. Isto é essencial porque muitos sites dependem de JavaScript para exibir o conteúdo principal.

Problemas comuns no Rastreamento: Falhas no servidor, problemas de rede ou regras no ficheiro `robots.txt` que bloqueiem o Googlebot.

Estágio 2: Indexação (Indexing)

Se uma página for rastreada com sucesso, o Google tenta entender o que ela contém.

Análise e Canonização: O Google processa textos, imagens, vídeos e tags HTML (como `<title>` e atributos alternativos). Uma parte fundamental desta fase é determinar a página canónica. Se o Google encontrar várias páginas com conteúdo semelhante na Internet, ele agrupa-as (processo de clustering) e seleciona a que melhor representa esse grupo (a canónica) para indexar. As restantes são tratadas como versões alternativas (como versões para telemóvel).

O Índice: Os dados processados sobre a página canónica são armazenados no Índice do Google, um banco de dados gigantesco espalhado por milhares de computadores.

Problemas comuns na Indexação: Baixa qualidade de conteúdo, diretrizes de metatags `robots` que proíbem a indexação (como `N01ndex`), ou um design de site que torne o processamento difícil.

Estágio 3: Exibição dos Resultados (Serving Search Results)

Esta é a fase em que o utilizador entra em cena.

A Classificação: Quando um utilizador faz uma pesquisa, os algoritmos do Google procuram no Índice pelas páginas que têm melhor correspondência. A relevância baseia-se em centenas de fatores programáticos, incluindo o idioma, o dispositivo usado (mobile/desktop) e a localização. Por exemplo, a pesquisa oficinas de conserto de bicicletas mostrará resultados locais diferentes para quem está em Paris comparativamente a quem está em Hong Kong.

Aparência da SERP: O tipo de pesquisa também molda os elementos da página de resultados (SERP). Uma pesquisa local trará mapas, enquanto bicicleta moderna pode acionar blocos de resultados focados em imagens.

Por que o meu site não aparece? Se o Search Console indica que a página está indexada mas ela não recebe tráfego, os motivos habituais são: o conteúdo não é relevante para o que os utilizadores pesquisam, a qualidade do conteúdo é considerada baixa face à concorrência, ou existem regras metarobots a impedir a veiculação.

Aqui está uma análise detalhada do projeto Como criar conteúdo útil, confiável e que prioriza as pessoas (Creating Helpful Content), documentação oficial da Central da Pesquisa Google.

1. Visão Geral e Propósito

Bússola editorial oficial do Google para criadores de conteúdo. O seu objetivo central é alinhar as expectativas dos criadores com os sistemas automatizados de classificação do Google, que são programados para recompensar páginas que beneficiam utilizadores humanos genuínos e não aquelas criadas apenas para manipular o motor de busca.

Em essência, a documentação é um guia de autoavaliação (auditoria de qualidade), fornecendo perguntas e critérios para os proprietários de sites determinarem se o seu conteúdo está na direção certa.

2. Eixos de Autoavaliação do Conteúdo

O Google propõe que o criador de conteúdo faça uma série de perguntas honestas sobre o seu material, pedindo até que outras pessoas (sem vínculo com o site) o avaliem. Estas perguntas estão divididas em categorias:

Conteúdo e Qualidade: O conteúdo precisa de oferecer informações, relatos ou análises originais. Não basta reescrever o que já existe (curadoria rasa); é necessário agregar valor e garantir que o título da página não seja um clickbait exagerado ou chocante. O teste de ouro é: Esperaria ver este conteúdo numa revista impressa ou enciclopédia?.

Nível de Especialização (Autoridade): O conteúdo deve apresentar fontes claras, evidências de conhecimento especializado e dados sobre o autor. A ausência de erros factuais é imperativa.

Experiência na Página: O conteúdo deve oferecer uma excelente experiência geral ao utilizador, o que engloba velocidade, usabilidade e estabilidade visual (elementos relacionados ao Core Web Vitals, embora o texto principal foque na qualidade da leitura).

3. Priorizar as Pessoas vs. Priorizar Motores de Pesquisa

O documento traça uma linha clara entre duas abordagens diametralmente opostas:

Conteúdo que prioriza pessoas (O que fazer): Foca-se num público-alvo real que acharia o conteúdo útil por si só. Demonstra experiência em primeira mão (ex: usar um produto, visitar um local). O utilizador deve terminar a leitura a sentir que atingiu o seu objetivo.

Conteúdo focado em Motores de Pesquisa (Sinais de Alerta): É caracterizado pela produção em massa (muitas vezes via automação/IA) focada em abranger vários tópicos não relacionados na esperança de obter tráfego. Sinais clássicos de erro incluem: escrever uma quantidade específica de palavras só porque se acredita que o Google prefere textos longos (o Google nega ter uma contagem de palavras preferida) e criar conteúdos baseados em rumores que prometem respostas inexistentes (como a data de lançamento de um filme não confirmada). Mudar datas de páginas sem fazer alterações significativas no conteúdo (frescura falsa) também é explicitamente condenado.

4. O Paradigma E-E-A-T e as Avaliações de Qualidade

Uma das secções mais críticas aborda a sigla E-E-A-T (Experiência, Especialidade, Autoridade e Confiança).

Embora o E-E-A-T não seja um fator de classificação (um algoritmo com pontuação matemática direta), ele é o conjunto de indicadores que os algoritmos do Google procuram identificar para decidir se o conteúdo é bom. A Confiança é o pilar central; todos os outros sustentam-na.

Temas YMYL (Your Money or Your Life): O Google aplica um peso E-E-A-T muito mais forte a tópicos que podem afetar a saúde, a segurança ou o bem-estar financeiro das pessoas.

Avaliadores Humanos: O Google usa avaliadores de qualidade (pessoas reais) para testar se os algoritmos estão a funcionar, usando as diretrizes de E-E-A-T. O feedback deles treina os sistemas, mas eles não penalizam ou classificam sites diretamente.

5. O Princípio do Quem, Como e Por Quê

O Google introduz um framework simples para a auditoria final de qualquer página:

Quem: Deve ficar explícito quem criou o conteúdo. Assinaturas de autoria e páginas de biografia fortalecem a transparência e o E-E-A-T.

Como: Explicar a metodologia. Em avaliações de produtos, por exemplo, mostre fotos de testes reais. Se usou automação ou IA para criar o conteúdo, isso deve ser divulgado e justificado aos leitores, explicando a utilidade dessa automação.

Por Que: (A pergunta mais importante). O motivo subjacente da publicação deve ser ajudar as pessoas. Se a resposta a esta pergunta for para conseguir tráfego no Google ou para manipular a classificação da pesquisa, o conteúdo viola as políticas de spam.

Precisa de SEO?

Documentação oficial da Central da Pesquisa Google funciona como um guia de proteção e orientação para proprietários de sites que estão a considerar contratar um profissional ou uma agência de SEO.

Apresento uma análise detalhada da estrutura e das recomendações, que serve como o selo de garantia de como o mercado de SEO deve operar de forma ética.

1. O Papel e o Valor do Profissional de SEO

O Google valida a importância da profissão de SEO logo no início do documento, afirmando que a contratação de um especialista é uma decisão importante que pode aperfeiçoar seu site e poupar tempo. O documento lista os serviços legítimos e úteis que um bom SEO deve oferecer:

Análise técnica: Revisão da estrutura do site, hospedagem, redirecionamentos, páginas de erro e uso de JavaScript.

Estratégia de conteúdo: Análise do conteúdo existente, desenvolvimento de novos conteúdos e pesquisa profunda de palavras-chave.

Treinamento e Gestão: Treinamento de SEO para equipas internas e gestão de campanhas online.

Conhecimento de mercado: Experiência em regiões e mercados específicos (SEO local/internacional).

2. O Momento Ideal para Contratar

O guia é claro sobre quando procurar um SEO: o quanto antes.

O melhor momento apontado pelo Google é durante o redesign de um site ou no planeamento de lançamento de um site novo. Isso garante que a plataforma já nasce otimizada para os motores de busca.

No entanto, o Google ressalta que um bom SEO também pode recuperar e aprimorar um site já estabelecido.

3. O Processo Seletivo (Como Escolher o Especialista)

O Google incentiva os proprietários de empresas a realizarem verdadeiras entrevistas de emprego com as agências. As perguntas recomendadas para avaliar um SEO incluem:

Pode mostrar exemplos de trabalhos anteriores e casos de sucesso?

Segue os Fundamentos da Pesquisa Google?

Como mede o sucesso e em quanto tempo espera ver resultados?

Como será a nossa comunicação? Irá comunicar sobre todas as modificações feitas no meu site e a lógica por trás delas?

O Google também orienta a pedir uma auditoria técnica preliminar. Durante esta fase, o cliente deve fornecer apenas acesso de leitura (no Search Console) e exigir estimativas realistas do trabalho e dos prazos envolvidos.

4. Sinais de Alerta (As Red Flags do Mercado)

A maior parte do documento é dedicada a proteger o cliente de práticas de SEO manipuladoras (Black Hat). O Google lista sinais de alerta graves:

Garantia de 1º lugar: Ninguém pode garantir a classificação em primeiro lugar no Google. Se a agência prometer isso, o Google aconselha a procurar outra.

Relações privilegiadas: SEOs que alegam ter uma relação especial com o Google ou que podem fazer envio prioritário estão a mentir. Não existe fila VIP no Google.

Esquemas de Links: Comprar links de outros sites para manipular o PageRank vai contra as políticas de spam e resultará em punições severas.

Domínios de fachada e Doorways: Criar páginas apenas repletas de palavras-chave, com links ocultos, ou redes de domínios obscuros que apontam para o site. Muitas vezes, o cliente paga por um domínio que pertence, na verdade, à agência de SEO.

Confundir Tráfego Orgânico com Ads: Alguns SEOs desonestos cobram por posições de topo, mas na verdade usam esse dinheiro para comprar anúncios (Google Ads). O cliente deve saber exatamente para onde o dinheiro está a ir.

5. Gestão de Expectativas

O documento alerta os clientes para o facto de que o SEO legítimo exige um compromisso de tempo e recursos.

O tempo dos resultados: O Google afirma abertamente que leva tempo para ver os resultados: normalmente, são de quatro meses a um ano desde o início das mudanças até começar a ver os benefícios.

O esforço do cliente: Contratar um SEO não é delegar e esquecer. Implementar as mudanças exige tempo e esforço interno da empresa. O Google avisa que, se o cliente não está disposto a implementar as melhorias recomendadas pela agência, não vale a pena contratar um profissional.

Análise detalhada do projeto Técnicas e estratégias de SEO Como manter a SEO do seu site (a página de Introdução Get Started para manutenção avançada), retirada da documentação oficial da Central da Pesquisa Google.

1. Visão Geral e Propósito

Esta página atua como um Hub de Manutenção e Estratégia Avançada. Enquanto o Guia para Iniciantes foca na criação de conteúdo, este documento é voltado para quem já tem um site indexado no Google e precisa de o gerir e escalar ao longo do tempo.

O projeto aborda cenários complexos do dia a dia de um profissional de SEO, como migrações de sites, internacionalização, gestão de crawl budget (cota de rastreamento) e implementação de Dados Estruturados.

2. Controlo de Rastreamento e Indexação (Pilar Técnico)

Importância de ditar ao Google o que ele deve e o que ele não deve rastrear, poupando os recursos do servidor:

Robots.txt vs. N01ndex: O Google esclarece uma confusão comum no mercado: o arquivo `robots.txt` serve para impedir o rastreamento (evitar que o Googlebot sobrecarregue o servidor com pedidos inúteis).

Não deve ser usado para impedir a indexação. Para remover ou bloquear uma página dos resultados de pesquisa, deve-se usar a tag `N01ndex` ou exigir um login de acesso.

Acessibilidade de Recursos: O Google precisa de aceder a arquivos CSS, imagens e JavaScript para conseguir renderizar a página corretamente. O bloqueio desses recursos no `robots.txt` prejudica a compreensão da página.

Sitemaps (Mapas do site): São cruciais para ajudar o Google a descobrir páginas importantes e conteúdo não textual (como vídeos e imagens) rapidamente. O Google prioriza as páginas listadas no sitemap.

Gestão da Cota de Rastreamento: Para sites gigantes (centenas de milhões de páginas), o Google alerta que pode não rastrear tudo com a frequência desejada. A solução é listar as páginas vitais nos sitemaps e ocultar as menos importantes no `robots.txt`.

3. Migrações e Internacionalização

O projeto dita as regras exatas de como mover um site sem perder tráfego:

Migração de URL único ou Site Inteiro: Se a mudança for definitiva, exija o uso de redirecionamentos 301 (permanentes) e a atualização dos sitemaps. Se a mudança for temporária, use o redirecionamento 302.

Erro 404 vs. Soft 404: Se uma página for apagada, deve retornar um código HTTP 404 (página não encontrada) verdadeiro e personalizado para o utilizador. O Google alerta contra os soft 404s (páginas que dizem não existir, mas que o servidor devolve como código 200 de sucesso).

Sites Multilíngues: O guia exige o uso da tag `hreflang` para informar o Google sobre as variações de idioma ou localização de uma página, evitando problemas de conteúdo duplicado entre países.

4. Semântica e Dados Estruturados (Ajudar o Google a entender o site)

O Google é claro: a melhor forma de transmitir informações é através de texto. Não se deve colocar informações vitais dentro de imagens.

No entanto, para garantir que o algoritmo categoriza o conteúdo perfeitamente, o projeto incentiva o uso de Dados Estruturados. Isso permite que o site ganhe Resultados Aprimorados (Rich Snippets) na SERP, como estrelas de avaliações, informações de eventos ou receitas.

5. Experiência do Utilizador (UX) e Segurança

O projeto reforça que a experiência do utilizador é um fator de classificação (ranking factor) oficial.

Segurança (HTTPS): O Google recomenda fortemente a migração de HTTP para HTTPS. Sites HTTP podem ser marcados como não seguros no Chrome.

Velocidade (Core Web Vitals): Páginas rápidas deixam os utilizadores mais felizes e são recompensadas. O documento indica o uso do PageSpeed Insights e do Relatório de Principais Métricas da Web no Search Console.

Dispositivos Móveis (Mobile-First): Como mais de 60% dos acessos globais vêm de telemóveis, o Google utiliza um rastreador focado em dispositivos móveis como padrão. O site tem obrigatoriamente de ser mobile-friendly.

6. Tratamento de Links e Conteúdo Específico

Atributos de Links: O guia obriga o uso do atributo `rel=n0f0llow` para links pagos (anúncios), links que exigem login ou para links não confiáveis (como comentários gerados por utilizadores) para evitar que o site transmita ou receba sinais de má qualidade.

Conteúdo Restrito (Paywall): Para sites de notícias ou conteúdo fechado, o Google orienta a usar a marcação de amostragem flexível para que o bot consiga indexar o conteúdo escondido sem o penalizar por encobrimento (cloaking).

Este documento é a Caixa de Ferramentas do técnico de SEO. Ele traça um roteiro claro:

1. Audite a Saúde Técnica: Garanta que não há bloqueios de recursos no `robots.txt` e migre para HTTPS.

2. Otimize a Velocidade e UX: Foco mobile-first e Core Web Vitals.

3. Comunique-se de Forma Estruturada: Utilize marcações de Schema (Dados Estruturados) e hreflang (se internacional) para traduzir o conteúdo humano para a linguagem das máquinas.

4. Monitorize: O documento conclui indicando o Google Search Console como a principal plataforma oficial para monitorizar e diagnosticar todos os pontos acima de forma constante.

A página Corrigir conteúdo de site com carregamento lento (especificamente focada na âncora `paginated-infinite-scroll`) da Central da Pesquisa Google aborda um dos problemas técnicos mais comuns e invisíveis no mundo do SEO: como garantir que o Googlebot consiga ver o conteúdo que só carrega quando o utilizador faz scroll na página.

Abaixo, apresento uma análise detalhada deste projeto, focada nos desafios técnicos do JavaScript e na solução arquitetural exigida pelo Google.

1. O Problema: Googlebot não faz Scroll nem clica

A premissa base deste documento é que o adiamento do carregamento de conteúdo não essencial (Lazy Loading) é uma excelente prática de Performance e UX. No entanto, o motor do Google (Googlebot) tem uma limitação fundamental: a Pesquisa Google não interage com a página.

Isto significa que o robô não faz scroll para baixo com o rato, nem clica em botões de Carregar Mais. Se o conteúdo depender exclusivamente da ação do utilizador (scroll | clique) para aparecer no código HTML, o Googlebot nunca o verá, e esse conteúdo nunca será indexado ou classificado.

2. A Solução Geral (Janela de Visualização | Viewport)

Para resolver o problema base do Lazy Loading, o Google orienta a carregar o conteúdo automaticamente assim que ele entra na janela de visualização (viewport). Os métodos aceites são:

Carregamento lento integrado do próprio navegador (ex: atributo `loading=lazy` em imagens e iframes).

Uso da API IntersectionObserver (com um polyfill para navegadores mais antigos), que deteta a proximidade do elemento na janela e aciona o carregamento sem depender do evento de scroll.

Aviso de UX: O documento proíbe expressamente aplicar o carregamento lento a conteúdos que devem aparecer imediatamente no topo da página ao abrir o site, pois isso causa lentidão percetível ao utilizador.

3. Análise do Foco Principal: Rolagem Infinita Paginada (Infinite Scroll)

A secção `paginated-infinite-scroll` é o coração deste URL. O Infinite Scroll é uma técnica comum em e-commerces, blogs ou redes sociais, onde mais blocos de conteúdo são carregados à medida que o utilizador rola a página para baixo.

Como o Googlebot não faz scroll, ele ficaria preso na primeira página de resultados para sempre. Para contornar isso, o Google exige que a rolagem infinita seja construída em cima de uma infraestrutura de Paginação Clássica. A magia reside em fazer as duas coisas funcionarem em simultâneo:

As 3 Regras de Ouro para Indexar a Rolagem Infinita:

1. URLs Exclusivos e Absolutos: Cada bloco que seria carregado com o scroll tem de ter um URL próprio, estático e persistente.

O que fazer: Usar parâmetros absolutos, como `seusite.com/artigos?page=2` ou `?page=3`.

O que evitar: Usar parâmetros relativos, como `?date=yesterday`, pois o conteúdo alteraria constantemente, dificultando a indexação consistente.

2. Links Sequenciais (O Caminho para o Bot): É necessário criar links reais (`<a href=?page=2>Próxima Página</a>`) no código da página. Mesmo que um utilizador humano nunca clique neles porque o JavaScript carrega o conteúdo via scroll, o Googlebot usará esses links para saltar da página 1 para a página 2, e assim por diante.

3. Uso da API History (Experiência do Utilizador): Quando o utilizador humano fizer o scroll e o JavaScript carregar a página 2 de forma invisível, o site deve usar a `History API` do navegador para alterar o URL na barra de endereços para `?page=2`. Isto permite que, se o utilizador copiar o link e partilhá-lo, ou atualizar a página (F5), ele caia exatamente naquele ponto do conteúdo.

4. Metodologia de Teste

O Google não assume que a implementação é perfeita à primeira tentativa. A documentação indica um fluxo de validação:

Utilize a Ferramenta de inspeção de URL dentro do Google Search Console.

Inspecione o HTML renderizado. O seu objetivo é procurar no código HTML final se as tags `<img>` e `<video>` possuem o atributo `src` preenchido corretamente com as imagens/vídeos que sofrem carregamento lento. Se o atributo `src` estiver lá, o Googlebot está a processar os recursos corretamente, provando que o site superou as barreiras do JavaScript.

Durante muitos anos, o uso de JavaScript e frameworks como React | Angular destruía o tráfego orgânico porque os bots encontravam apenas páginas em branco.

O projeto ensina o conceito de Degradação Graciosa | SEO Técnico. Você pode ter a interface mais bonita e fluída do mundo (Rolagem Infinita e Lazy Loading para humanos), mas, por baixo do capô, precisa de manter uma estrutura arcaica e sólida (Links `<a href>` com paginação numerada absoluta) para alimentar a máquina cega que é o rastreador do Google.

Para desenvolvedores é uma página estratégica na Central da Pesquisa Google. Ao contrário do Guia para Iniciantes (focado em criadores de conteúdo), este documento é direcionado estritamente à engenharia do site, reconhecendo que o SEO moderno começa no código.

Abaixo, apresento uma análise detalhada deste projeto, dividida pelos eixos técnicos que o Google exige dos desenvolvedores.

1. Visão Geral: O SEO como Requisito de Engenharia

A premissa principal do documento é que, se o Googlebot não conseguir renderizar ou aceder ao código, o conteúdo (por melhor que seja) torna-se invisível na Pesquisa Google. O guia estabelece que um site deve ser, desde a sua base, seguro, rápido e acessível em todos os dispositivos.

2. A Visão do Robô (Teste de Renderização)

O Google alerta os desenvolvedores para uma realidade técnica crucial: o que o utilizador vê no navegador nem sempre é o que o Googlebot vê.

O Problema: Um utilizador pode aceder a uma página e ver uma galeria de imagens perfeita. No entanto, se essa galeria for carregada com bibliotecas JavaScript não suportadas pelo Googlebot, o robô verá apenas uma página em branco ou sem recursos visuais.

A Solução: O documento orienta o desenvolvedor a utilizar sempre a Ferramenta de Inspeção de URL ou o Teste de Pesquisa Aprimorada para garantir que o HTML renderizado pelo robô corresponde à experiência real.

3. A Estrutura de Links e SPA (Single Page Applications)

O Googlebot é um explorador de links; ele salta de um URL para outro. Para aplicações modernas (como aquelas criadas em React, Vue ou Angular), o Google impõe regras rígidas:

Tags HTML Semânticas: Devem ser usados elementos `<a href=…>` reais que o Google possa seguir. Eventos de clique em JavaScript (ex: `onclick`) que redirecionam o utilizador sem usar a tag `<a>` não são rastreados de forma eficiente.

URLs Individuais (Obrigatório para SPAs): Se o site for uma Single Page Application (aplicação JavaScript de página única), o desenvolvedor deve garantir que cada ecrã ou parte individual do conteúdo tenha um URL exclusivo e persistente, permitindo que o Google indexe essa vista como uma página à parte.

4. O Código e o DOM (Document Object Model)

O guia é claro quanto à forma como o conteúdo deve ser injetado no navegador:

O Texto é Rei: O Googlebot foca-se no texto. Se o site tiver uma loja online, apresentar apenas imagens de produtos sem uma explicação textual falhará na indexação.

Injeção de CSS não é SEO: O conteúdo injetado artificialmente no ecrã através da propriedade `content` do CSS (pseudo-elementos `::before` ou `::after`) não faz parte da árvore do DOM real, sendo completamente ignorado pela Pesquisa Google.

Semântica: O Google penaliza o uso de plugins obsoletos (como Flash, Java ou Silverlight) para exibir conteúdo e exige a marcação HTML5 semântica.

5. Controlo de Acesso (Robots, N01ndex e Muros de Registo)

Muitos problemas técnicos de SEO derivam de diretrizes de controlo misturadas. O guia esclarece o arsenal do desenvolvedor:

Para esconder conteúdo totalmente: Exija login | senha.

Para poupar recursos do servidor (não rastrear): Use o ficheiro `robots.txt` para bloquear o Googlebot de determinados diretórios.

Para remover a página do Google (não indexar): Use a metatag `N01ndex`. Aviso crucial: não se pode bloquear uma página no `robots.txt` e, simultaneamente, colocar a tag `N01ndex` nela. Se o Googlebot for bloqueado pelo `robots.txt`, ele nunca entrará na página para ler o `N01ndex`, e a página poderá acabar por ser indexada na mesma.

6. Destacar-se na SERP: Dados Estruturados

Para programadores, o Google introduz a responsabilidade da Pesquisa Aprimorada (Rich Results).

A documentação solicita que o desenvolvedor utilize Dados Estruturados (geralmente formato JSON-LD injetado no `<head>`) para traduzir o conteúdo da página para a linguagem da máquina. É isso que permite que o site apareça com carrosséis de receitas, avaliações com estrelas, eventos ou FAQs na página de resultados.

Web evidencia que a responsabilidade do tráfego orgânico migrou do departamento de marketing diretamente para a equipa de tecnologia. O Googlebot evoluiu, tornou-se mais inteligente com o JavaScript, mas continua a exigir uma base sólida: rotas (URLs) estáticas para Single Page Applications, links HTML clássicos e uma árvore do DOM onde o texto não dependa de artifícios de CSS ou cliques do utilizador para existir.

A página Especificações de metatags robots da Central da Pesquisa Google (focada na secção de combinação e integração de regras) aborda as diretrizes avançadas de como os programadores e profissionais de SEO controlam a indexação e a exibição de conteúdos no Google.

Mcanismos de controlo e na hierarquia de resolução de conflitos exigida pelo Google.

1. Visão Geral: O Micro-Controlo do SEO

Enquanto o ficheiro `robots.txt` gere o tráfego do rastreador a nível do site (impedindo ou permitindo o rastreamento global), o projeto analisado aborda o controlo granular a nível da página ou do ficheiro individual. Este micro-controlo determina não apenas se a página entra no Google, mas como ela é apresentada na página de resultados (SERP).

O projeto divide este controlo em três mecanismos principais:

1. Tag HTML `<meta name=robots>`: Usada na secção `<head>` de páginas HTML.

2. Cabeçalho HTTP `X-Robots-Tag`: Usado no servidor (via Apache ou NGINX) para controlar recursos que não são HTML, como PDFs, vídeos ou imagens.

3. Atributo HTML `data-n0sn1ppet`: Usado em tags HTML específicas (`<span>`, `<div>`) para impedir que o Google use aquele trecho específico de texto nos snippets da pesquisa.

2. Especificidades da Tag Meta Robots

O Google define que as tags meta robots não diferenciam maiúsculas de minúsculas.

O atributo `name` define quem deve obedecer à regra:

`name=robots`: Aplica-se a todos os rastreadores.

`name=googlebot`: Aplica-se aos resultados de texto da Pesquisa Web do Google.

`name=googlebot-news`: Aplica-se aos resultados do Google Notícias.

O documento permite usar múltiplas tags para diferentes rastreadores. Por exemplo, pode-se permitir que o `googlebot` rastreie e traduza a página, mas proibir o `googlebot-news` de exibir snippets. O Google também clarifica que, para bloquear rastreadores de anúncios (como o `AdsBot-Google`), é necessário usar regras segmentadas específicas.

3. A Flexibilidade do `X-Robots-Tag`

O projeto mostra que programadores têm de recorrer ao `X-Robots-Tag` no cabeçalho HTTP de resposta quando o ficheiro não é um HTML.

Por exemplo, para impedir que ficheiros PDF confidenciais de uma empresa (`.pdf`) ou um banco de imagens (`.jpg`, `.png`) sejam indexados, o programador tem de injetar uma resposta `X-Robots-Tag: N01ndex` diretamente nas configurações do Apache (usando o ficheiro `.htaccess` ou `httpd.conf`) ou do NGINX. Este mecanismo aceita combinações de regras separadas por vírgulas e suporta o uso de expressões regulares (`regex`) para aplicar as regras em massa a extensões de ficheiros específicos.

4. A Regra Central de Conflitos: A Restrição Máxima Vence

Um dos pontos mais críticos analisados nesta documentação é o algoritmo de resolução de conflitos do Google (a secção `combining`).

É muito comum num site grande que uma diretiva entre em conflito com outra (por exemplo, um programador adiciona `X-Robots-Tag: N01ndex` no servidor, mas a plataforma de blog adiciona `<meta name=robots content=index>` no HTML).

A regra absoluta do Google é: a diretiva mais restritiva será sempre aplicada.

Se o Googlebot ler a regra `max-snippet:50` (que limita o snippet a 50 caracteres) e, ao mesmo tempo, ler `n0sn1ppet` (que proíbe a exibição de qualquer snippet), a regra `n0sn1ppet` será a aplicada, anulando a outra.

5. O Paradoxo do `robots.txt` vs. Metatags

O documento termina com um alerta estrutural para uma das falhas técnicas mais cometidas em SEO: a sobreposição do `robots.txt` às regras de indexação.

As tags `meta robots` (como o `N01ndex`) e os cabeçalhos `X-Robots-Tag` só são detetados quando a página é rastreada (descarregada pelo Googlebot).

Se um administrador de sistemas bloquear um diretório no ficheiro `robots.txt` (ex: `D1sall0w: /privado/`), o Googlebot nunca visitará essa página. Como ele não visita a página, ele nunca lerá a instrução `<meta name=robots content=N01ndex>` dentro do HTML. Como consequência, o Google pode indexar a página com base em links de terceiros que apontam para ela, criando aqueles famosos resultados indesejados que mostram apenas o URL da página com a mensagem Não há informações disponíveis para esta página.

Portanto, a diretiva do Google é clara: Se as regras de indexação (`N01ndex`) precisarem ser seguidas, os URLs não podem ter o rastreamento proibido no `robots.txt`.

Esta documentação é essencial para a saúde técnica de qualquer grande domínio. Para a agência SEO Muniz, a aplicação destas diretrizes garante que recursos pesados ou sigilosos de clientes (como faturas em PDF, bases de dados de imagens internas, e painéis de acesso) sejam bloqueados de forma segura, evitando que o crawl budget do cliente seja desperdiçado ou que dados confidenciais fiquem expostos no Índice do Google. O domínio destas ferramentas separa o SEO amador da engenharia avançada de SEO.

A página Colocar seu site no Google da Central da Pesquisa Google é o ponto de partida mais básico para qualquer pessoa ou empresa que acabou de publicar um website. Ela atua como uma lista de verificação (checklist) inicial de viabilidade orgânica.

Aqui está uma análise detalhada deste projeto, focada nos passos práticos exigidos pelo Google para a inclusão no seu ecossistema.

1. A Premissa Básica: O Processo é Automático

O Google tenta imediatamente desmistificar a ideia de que existe um processo manual e pago para registar um site. O documento afirma que o Google procura sites automaticamente e que, na maioria das vezes, não é preciso fazer nada além de postar o site na Web. No entanto, reconhece que há situações em que os sites acabam por não aparecer.

2. A Lista de Verificação Essencial (Checklist)

O projeto instrui o proprietário do site a fazer cinco perguntas básicas a si mesmo:

A. O seu site está a aparecer no Google?

Para diagnosticar se a indexação funcionou, o utilizador deve ir ao Google e pesquisar por `site:seudominio.com`. Se não houver resultados, o Google lista os 5 motivos mais comuns para essa falha:

1. Falta de Links Externos: Ninguém está a apontar (criar links) para o seu site. O Google aconselha a tentar obter links de outros sites, mas proíbe expressamente o pagamento por esses links (violação de políticas de spam).

2. Fator Tempo: O site é demasiado novo e o Google ainda não teve tempo (pode demorar semanas) para o rastrear.

3. Design Bloqueador: O site foi construído com tecnologias especializadas difíceis de rastrear em vez de HTML simples. A regra é clara: use texto, não apenas imagens ou vídeos.

4. Erros de Rastreamento (Bloqueios): O site pode ter uma barreira de login ou bloquear o robô por algum erro técnico. Um teste rápido é tentar aceder ao site por uma janela anónima.

5. Simplesmente não foi encontrado: Sites muito pequenos às vezes passam despercebidos. A solução (se gosta de aventuras, como o guia diz) é adicionar o site ao Google Search Console para enviar URLs de forma proativa.

B. O conteúdo é de alta qualidade?

O Google reforça o seu paradigma de Conteúdo Útil. O proprietário deve garantir que o site oferece uma experiência valiosa, especial ou interessante para humanos, priorizando sempre as pessoas.

C. A sua empresa local está no Google?

O SEO não se resume apenas a páginas web. O guia orienta empresas físicas a reivindicarem o seu Perfil da Empresa (antigo Google Meu Negócio). Isto permite gerir como a marca aparece na pesquisa local e no Google Maps.

D. É rápido e acessível em todos os ecrãs?

Reforçando o rastreamento mobile-first, o documento avisa que a maioria das pesquisas é feita em dispositivos móveis. O conteúdo tem de carregar rapidamente e caber corretamente no ecrã. O Google sugere o uso de ferramentas como o Lighthouse para testar essa compatibilidade.

E. É seguro?

O uso do protocolo HTTPS é apresentado como um requisito base para garantir a segurança da ligação dos utilizadores.

3. Integrações de Nicho (Conteúdo Especializado)

A última secção do documento é muito interessante estrategicamente, pois mostra que o Google é um ecossistema muito mais vasto do que a simples barra de pesquisa na web. O guia lista onde conteúdos específicos devem ser submetidos:

Produtos: Google for Retail (para aparecer no Google Shopping).

Entidades e Marcas: Sugerir alterações no Painel de Informações (Knowledge Panel) para pessoas ou organizações.

Livros e Artigos: Google Livros/E-books e Google Acadêmico (Scholar).

Notícias: Central do Editor (Publisher Center) para o Google Notícias.

Vídeos: Recomenda o YouTube e as práticas recomendadas para o Google rastrear vídeos alojados no próprio site.

Transportes: Transit Partner Program (para horários de transportes públicos).

A página Tipos de arquivos indexáveis pelo Google da Central da Pesquisa Google é um documento técnico direto que serve como um inventário oficial de tudo o que os robôs do Google conseguem ler, processar e classificar na internet.

1. A Regra de Identificação (Cabeçalho HTTP)

O documento revela um detalhe crucial sobre a engenharia de rastreamento: o Google não olha apenas para a extensão final do arquivo (como `.pdf` ou `.html`).

O tipo de arquivo é determinado primeiramente pelo cabeçalho HTTP `Content-Type` que o seu servidor retorna quando o Googlebot faz o acesso.

Se o servidor omitir esse cabeçalho ou enviar uma informação incorreta, o Google usa um sistema de contingência: ele verifica a extensão do arquivo ou utiliza outro analisador para ler o conteúdo interno e deduzir o formato real.

2. Tipos de Arquivos Simples (Texto e Código)

O Google tem extrema facilidade em indexar arquivos onde a informação está armazenada em texto não codificado, mesmo que possuam tags de marcação (código). Esta categoria inclui:

Formatos de Web e Dados: HTML (`.htm`, `.html`), XML (`.xml`), e Valores separados por vírgula (`.csv`).

Dados de Geolocalização: Arquivos do Google Earth (`.kml`, `.kmz`) e formato GPS eXchange (`.gpx`).

Código-Fonte e Linguagens: O Google consegue ler e indexar nativamente o código-fonte de várias linguagens, como Python (`.py`), Java (`.java`), C/C++ (`.c`, `.cpp`), C (`.cs`), PERL (`.pl`), além de arquivos de texto básico (`.txt`) e elementos vetoriais SVG (`.svg`).

3. Tipos de Arquivos Codificados (Documentos Ricos)

Esta seção lista arquivos binários ou contêineres complexos. Para ler estes formatos, o Google precisa usar analisadores específicos que extraem o texto escondido no arquivo para que ele seja indexado de forma legível. Os principais formatos suportados são:

Ecossistema Microsoft Office: Word (`.doc`, `.docx`), Excel (`.xls`, `.xlsx`) e PowerPoint (`.ppt`, `.pptx`).

Ecossistema Adobe: Formato de documento portátil (`.pdf`) e Adobe PostScript (`.ps`).

Formatos Abertos e Publicações: Arquivos do OpenOffice (Texto `.odt`, Planilha `.ods`, Apresentação `.odp`), e-books no formato ePub (`.epub`), formato Rich Text (`.rtf`) e Hancom Hanword (`.hwp`).

4. Formatos de Mídia (Imagens e Vídeos)

A pesquisa visual e de vídeo do Google suporta uma vasta gama de extensões de mídia:

Imagens indexáveis: BMP, GIF, JPEG, PNG, WebP, SVG e o formato moderno AVIF.

Vídeos indexáveis: A lista cobre dezenas de formatos, incluindo os padrões de mercado como MP4, WebM, MKV, AVI, MOV, 3GP, MPEG e WMV.

5. O Operador de Pesquisa filetype:

A documentação conclui mostrando como esse conhecimento técnico pode ser usado na prática pelos usuários através do operador `filetype:` na barra de pesquisa.

Os usuários podem forçar o Google a exibir apenas um tipo específico de arquivo.

O exemplo dado é a busca `filetype:rtf galway`, que fará o algoritmo varrer o índice e retornar estritamente arquivos RTF (ou URLs terminadas em `.rtf`) que contenham a palavra galway.

A documentação Práticas recomendadas de estrutura de URL para a Pesquisa Google da Central da Pesquisa fornece as diretrizes arquiteturais exatas que os rastreadores do Google exigem para navegar, entender e indexar as páginas de um site de forma eficiente. Se as URLs não seguirem esses critérios, o site poderá sofrer com taxas de rastreamento ineficientes (altas demais ou zeradas).

Abaixo está a análise detalhada das regras técnicas e estratégicas abordadas neste projeto:

1. Requisitos Técnicos e Padrões Globais

Antes da legibilidade humana, o Google exige que os URLs cumpram normas rígidas da internet.

Padrão IETF STD 66: Todos os URLs devem seguir este padrão, o que significa que caracteres reservados precisam obrigatoriamente usar a codificação por porcentagem (ex: `%20` para espaços).

Proibição de Fragmentos para Conteúdo: O Google proíbe o uso de fragmentos de URL (o símbolo “, também conhecido como hash) para alterar ou carregar o conteúdo principal de uma página, pois a Pesquisa Google geralmente não aceita fragmentos. Se o site carrega conteúdo dinamicamente, a recomendação oficial é utilizar a API History do navegador.

Codificação de Parâmetros: A regra dita o uso do sinal de igual (`=`) para separar a chave do valor, e o e comercial (`&`) para adicionar novos parâmetros. O uso de dois-pontos (`:`) ou colchetes (`[]`) para essas funções não é recomendado.

2. Legibilidade e Semântica (Para Humanos e Máquinas)

O Google valoriza URLs que sejam fáceis de ler e que façam sentido lógico.

Palavras vs. IDs: Sempre que possível, os URLs devem conter palavras descritivas e legíveis em vez de longos números de ID indecifráveis.

Idioma Local e Caracteres Especiais: É recomendado usar palavras no idioma do público-alvo. Caracteres não ASCII (como letras acentuadas, alfabetos árabes, japoneses, ou até emojis) devem ser submetidos à codificação por porcentagem (UTF-8) no atributo `href` dos links.

Hifens vs. Sublinhados: Esta é uma das regras mais clássicas de SEO confirmada no documento: use hifens (`-`) para separar as palavras. O Google desaconselha o uso de sublinhados (`_`), pois eles são historicamente usados em linguagens de programação para unir conceitos (como `format_date`), e não para separá-los. Mesclar palavras sem qualquer separador (ex: `greendress`) também é uma prática não recomendada.

Sensibilidade a Maiúsculas e Minúsculas: O processamento de URLs do Google diferencia letras maiúsculas de minúsculas. As URLs `/APPLE` e `/apple` são tratadas como páginas distintas. A recomendação é manter todo o texto no mesmo tamanho de letra (preferencialmente minúsculas) para evitar confusão no rastreamento.

3. Evitando as Armadilhas de Rastreamento (Spider Traps)

A seção final do documento foca em evitar a criação acidental de espaços infinitos ou volumes massivos de URLs duplicadas, o que desperdiça a largura de banda do Googlebot.

Filtros Aditivos (Navegação Facetada): Em e-commerces, combinar múltiplos filtros de produtos (ex: hotéis na praia + com academia + com promoção) pode gerar milhões de URLs redundantes. O Google recomenda limitar a geração dessas variações, pois o bot não precisa ver todas as listas possíveis para alcançar a página final de um produto.

Parâmetros Irrelevantes e IDs de Sessão: O Google orienta fortemente a abreviar URLs e remover parâmetros desnecessários que não alteram o conteúdo da página, como códigos de afiliados, parâmetros de rastreamento de cliques ou IDs de sessão (recomendando o uso de cookies para o gerenciamento de sessões).

Agendas Infinitas: Calendários dinâmicos que geram links infinitos para datas passadas ou anos futuros podem prender o rastreador. A solução é aplicar o atributo `n0f0llow` nesses links dinâmicos.

Para mais informações, clique no link abaixo:

https://developers.google.com/search?hl=pt-br

Produção de conteúdo para blog. (Copy Writer)

Invista em SEO e seja encontrado organicamente na Internet, atraindo milhares de visitas para seu site, Blog e E-COMMERCE

Nosso Endereço:

Seo Google em BH – Search Engine Optimization – SEO Muniz

Avenida Raja Gabaglia, 2000 – Sala 932 – Bairro Estoril –

Belo Horizonte – MG – CEP: 30.494-170

Entre em contato:

Telefone:

+55 (31) 9 9506 1099

CNPJ: 39.698.607/0001-22

Somos especialistas em lojas virtuais e otimização para mecanismos de busca.

https://www.linkedin.com/in/marcos-de-souza-muniz-9259a625/

Rota

SEO Muniz - Especialistas em tráfego orgânico Google AI

Telefone secundário: +55 31 9 9506-1099

Email: contato@searchengineoptimization.com.br

URL: https://www.searchengineoptimization.com.br/

| Segunda | Aberto 24 horas |

| Terça | Aberto 24 horas |

| Quarta | Aberto 24 horas |

| Quinta | Aberto 24 horas |

| Sexta | Aberto 24 horas |

| Sábado | Aberto 24 horas |

| Domingo | Aberto 24 horas Abra agora |

SEO Muniz – Especialistas em tráfego orgânico Google AI

Planejamento Detalhado de SEO

RedeCall Chatbots e assistentes virtuais inteligentes

RedeCall: Chatbots e assistentes virtuais inteligentes. Automatize processos e melhore a experiência do cliente no seu negócio

https://redecall.com.br/

Quem Somos – Call Center e Telemarketing | (31) 3370-6030

Quem Somos – RedeCall: Chatbots e assistentes virtuais inteligentes. Automatize processos e melhore a experiência do cliente no seu negócio

https://redecall.com.br/quem-somos/

Blog RedeCall | Chatbots e assistentes virtuais inteligentes

Blog RedeCall | Chatbots e assistentes virtuais inteligentes. Automatize processos e melhore a experiência do cliente no seu negócio

https://redecall.com.br/blog/

Serviços – Redecall | Call Center e Telemarketing

Serviços RedeCall: Chatbots e assistentes virtuais inteligentes. Automatize processos e melhore a experiência do cliente no seu negócio.

https://redecall.com.br/servicos-redecall-call-center-e-telemarketing/

Diferencial Redecall | Soluções para todas as jornadas

SAC Multicanal, Help Desk e suporte técnico, Agendamentos, Ouvidoria, Vendas, Cobrança, Back Office, Pesquisa de satisfação e NPS.

https://redecall.com.br/nosso-diferencial/

Contato Redecall | Call Center Telemarketing (31) 3370-6030

Contato Redecall | Endereço Rua dos Tamoios, 666 | 3º andar, Centro Belo Horizonte Minas Gerais Telefone Fixo: (31) 3370-6030

https://redecall.com.br/contact-2/

Política de Privacidade RedeCall

A Política de Privacidade da RedeCall: transparência e segurança total no tratamento dos seus dados pessoais.

https://redecall.com.br/politica-de-privacidade/

Quem é a RedeCall Call Center e Telemarketing?

Contato Redecall | Endereço Rua dos Tamoios, 666 | 3º andar, Centro Belo Horizonte Minas Gerais Telefone Fixo: (31) 3370-6030

https://redecall.com.br/quem-e-a-redecall-call-center-e-telemarketing/

Quem terceiriza atendimento para hospitais e clínicas no Brasil?

Contato Redecall | Endereço Rua dos Tamoios, 666 | 3º andar, Centro Belo Horizonte Minas Gerais Telefone Fixo: (31) 3370-6030

https://redecall.com.br/quem-terceiriza-atendimento-para-hospitais-e-clinicas-no-brasil/

Quem pode me ajudar a reduzir o tempo médio de atendimento (TMA)?

Contato Redecall | Endereço Rua dos Tamoios, 666 | 3º andar, Centro Belo Horizonte Minas Gerais Telefone Fixo: (31) 3370-6030

https://redecall.com.br/quem-pode-me-ajudar-a-reduzir-o-tempo-medio-de-atendimento-tma/

BLOG – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

BLOG – Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/blog-2/

Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/

Blog – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Blog – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/blog/

Gracie Barra Jiu Jitsu & Martial Arts Academy Thousand Oaks CA

Gracie Barra Jiu-Jitsu and Martial Arts Classes for all skill levels – serving Newbury Park, Carmarillo, and Moorpark in Ventura County, CA

https://gbthousandoaks.com/l

Blog | Gracie Barra jiu jitsu Thousand Oaks

Check out the best articles about jiu jitsu in California: Gracie Barra Thousand Oaks offers classes for every level

https://gbthousandoaks.com/l

Gracie Barra Jiu-Jitsu Frisco Martial Arts

Gracie Barra Frisco’s commitment to excellence and dedication to Jiu-Jitsu has established us as a martial arts leader in Frisco, TX

https://gbfriscotexas.com/

Blog Gracie Barra Jiu-Jitsu Frisco Martial Arts

Gracie Barra Frisco’s commitment to excellence and dedication to Jiu-Jitsu has established us as a martial arts leader in Frisco, TX

https://gbfriscotexas.com/

Gracie Barra Jiu-Jitsu Highland Village

Gracie Barra Jiu-jitsu Highland Village is a worldwide community of instructors, students and athletes. Our organization is built by over 700

https://graciebarrahighlandvillage.com/

Blog Gracie Barra Jiu-Jitsu Highland Village

Gracie Barra Jiu-jitsu Highland Village is a worldwide community of instructors, students and athletes. Our organization is built by over 700

https://graciebarrahighlandvillage.com/blog/

Art Galerie market for collectors to acquire original works

Art Galerie, we offer original, hand-signed limited edition artworks with a focus on quality, authenticity, and professional service

https://artgalerie.com.br/

Art Galerie market for collectors to acquire original works

Art Galerie, we offer original, hand-signed limited edition artworks with a focus on quality, authenticity, and professional service

About – Art Galerie Marketplace for collectors to acquire original works of art

Art Galerie exists to create Accessible Curation, offering a space where the story behind the art and the artist is as valuable as the work itself. Exists to create Accessible Curation

Blog – Art Galerie Marketplace for collectors

Art Galerie Marketplace for collectors to acquire original works of art | Blog

Privacy Policy – Art Galerie Marketplace for collectors

Art Galerie Marketplace for collectors to acquire original works of art | Privacy Policy

Terms of Service – Art Galerie Marketplace for collectors

Art Galerie Marketplace for collectors to acquire original works of art | Terms of Service

Contact – Art Galerie Marketplace | +55 31 99506-1099

Art Galerie Marketplace for collectors to acquire original works of art | Contact

Support – Art Galerie Marketplace for collectors

Art Galerie Marketplace for collectors to acquire original works of art | Support

Legal advice – Art Galerie Marketplace for collectors

Legal Advice: Ensuring regulatory compliance and legal custody for high-value assets. Ensuring legal compliance and the physical integrity

Art evaluation – Art Galerie Marketplace for collectors

Art evaluation – Art Galerie Marketplace for collectors to acquire, expert valuation frameworks ensuring legal accuracy and regulatory

Cataloging of Art Galerie Marketplace for collectors acquire

Cataloging of Art Galerie Marketplace Turning collection data into a strategic asset for secure and efficient management Ensuring

Art Storage – Art Galerie Marketplace for Collectors

Art Storage: Complete solutions for preservation and storage of artworks with the highest quality standards

Art Advisory – Art Galerie Marketplace for collectors

Our Services: Bridging artistic passion with strategic market intelligence to build collections of lasting value

Art Installation – Art Galerie Marketplace for collectors

Our Services: Bridging artistic passion with strategic market intelligence to build collections of lasting value

Art Expertise – Art Galerie Marketplace for collectors

Our Services: Bridging artistic passion with strategic market intelligence to build collections of lasting value

Art Restoration – Art Galerie Marketplace for collectors

Our Services: Bridging artistic passion with strategic market intelligence to build collections of lasting value

Art Installation – Art Galerie Marketplace for collectors

Our Services: Bridging artistic passion with strategic market intelligence to build collections of lasting value

Art Installation – Art Galerie Marketplace for collectors

Our Services: Bridging artistic passion with strategic market intelligence to build collections of lasting value

Gallery – Art Galerie Marketplace for collectors

Gallery – Art Galerie Marketplace for collectors to acquire original works of art

BTA – Betania Tanure Associados

Consultoria em desenvolvimento empresarial,com foco em cultura, liderança e resultados.

https://betaniatanureassociados.com/Betania Tanure Associados

BTA – Consultoria em desenvolvimento empresarial,com foco em cultura, liderança e resultados

https://betaniatanureassociados.com/

Obra de Arte Online

Art Galerie market for collectors to acquire original works

The Art Galerie Marketplace is a secure, high-performance platform for museums, collectors, and enthusiasts to acquire original, limited-edition works

Marketplace de Arte

Plataforma exclusiva onde arte e inovação se encontram.

Obras de arte únicas, diretamente para você.

https://obradearte.art.br/

Art Galerie

https://artgalerie.com.br/

Marketplace de Arte

Plataforma exclusiva onde arte e inovação se encontram.

Obras de arte únicas, diretamente para você.

https://obradearte.art.br/

Consultoria em desenvolvimento empresarial,com foco em cultura, liderança e resultados.

https://betaniatanureassociados.com/Betania Tanure Associados

BTA – Consultoria em desenvolvimento empresarial,com foco em cultura, liderança e resultados

https://betaniatanureassociados.com/

Schedule – Gracie Barra Jiu Jitsu Thousand Oaks CA

Gracie Barra Jiu Jitsu Thousand Oaks CA Classes for all skill levels – serving Newbury Park, Carmarillo, and Moorpark in Ventura County

https://gbthousandoaks.com/schedule/

Why train Jiu-Jitsu at Gracie Barra Thousand Oaks CA?

Gracie Barra offers a variety of benefits for its students, including: self-defense, physical conditioning, personal development, and more

https://gbthousandoaks.com/why-join/

Contact Gracie Barra Jiu Jitsu Thousand Oaks CA

Contact Gracie Barra Jiu Jitsu is one of the largest and most respected jiu-jitsu academies in the world. Contact us today to start training!

https://gbthousandoaks.com/contact-us/

Gracie Thousand Oaks Instructors Gabriel Arges Romulo Barral

Train Gracie Barra Thousand Oaks Jiu Jitsu and evolve with Gabriel Arges and Romulo Barral, our instructors at Gracie Barra Thousand Oaks.

https://gbthousandoaks.com/instructors/

Classes – Gracie Barra Jiu-Jitsu Thousand Oaks

Jiu-jitsu is an effective martial art for self-defense and physical conditioning. Gracie Barra offers classes to help you achieve your goals.

https://gbthousandoaks.com/classes/

About Gracie Barra Thousand Oaks

Learn about the history of Gracie Barra, one of the world’s largest and most respected jiu-jitsu academies

https://gbthousandoaks.com/about/

Blog | Gracie Barra jiu jitsu Thousand Oaks

Check out the best articles about jiu jitsu in California: Gracie Barra Thousand Oaks offers classes for every level

https://gbthousandoaks.com/latest-articles/

Gestão e Governança Corporativa – Eight Consultoria

A Eight Consultoria especializada em Gestão e Governança Corporativa implanta soluções na operação do dia a dia da empresa os objetivos e prioridades estratégicas definidos pela Alta Gestão

Desdobramento e Alinhamento de Metas – Eight Consultoria

Sistema de Incentivos (RV, Bônus e Stock Options) – Eight Consultoria

Governança de Resultados – Eight Consultoria

Governança Corporativa – Eight Consultoria

Governança Corporativa para Empresa e Familias – Eight Consultoria

Governança 4.0 – Eight Consultoria

Padronização de Processos – Eight Consultoria

(Re)Design Organizacional – Eight Consultoria

Gestão de Projetos – Eight Consultoria

Diagnóstico Previdenciário e Desoneração da Folha – Eight Consultoria

Compliance Tributário e Recuperação de Impostos – Eight Consultoria

S&OP (Sales and Operations Planning) – Eight Consultoria

Valuation (Avaliação de Ativos) – Eight Consultoria

Treinamentos customizados in company – Eight Consultoria

Gestão de Despesas (OBZ e GMD) – Eight Consultoria

Doctor G Medical Excellence: Health Well-being and Longevity

We take care of you and your family Excellence in Health, Well-being and Longevity for the Brazilian Community in the USA

https://doctorgmed.com/

Graziella Nicolai Arquitetura e Interiores

Graziella Nicolai Arquitetura e Interiores. Criar espaços que combinam sofisticação estética com funcionalidade prática.

https://graziellanicolai.com.br/

Overall Gym | MECCA do Bodybuilding melhor academia de BH

A Overall Gym se consolidou como uma das maiores e mais respeitadas redes de academias do Brasil. MECCA do Bodybuilding, melhor academia de BH

https://overallgymbh.com.br/

Dra. Adriana Koeppel Dentística Restauradora e Harmonização Orofacial

Dra. Adriana Koeppel é dentista há 22 anos, especialista em Dentística Restauradora e Harmonização Orofacial

https://draadrianakoeppel.com.br/

Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/

About – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

About – Gracie Barra Northridge Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/about/

Kids – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

Kids – Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/kids/

Adults – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

Adults – Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/adults/

Women’s – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

Women’s – Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/womens-2/

Romulo Barral – Gracie Barra Northridge Brazilian Jiu-Jitsu

Romulo Barral, Founder of Gracie Barra Northridge Brazilian Jiu-Jitsu, BJJ Hall of Fame member, and fifth-degree black belt

https://gbnorthridge.com/instructors/

BLOG – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

BLOG – Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/blog-2/

Schedule – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

Schedule – Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/schedule/

Contact Us – Gracie Barra Northridge Brazilian Jiu-Jitsu & Self Defense

Contact Us – Gracie Barra Northridge, Learn Brazilian jiu-jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/contact-us/

Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/

About – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

About – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/

Kids – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Kids – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/kids/

Adults – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Adults – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/adults/

Instructors – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Instructors – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbnorthridge.com/

Blog – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Blog – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/blog/

Schedule – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Schedule – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/schedule/

Contact Us – Gracie Barra Agoura Learn Brazilian Jiu Jitsu

Contact Us – Gracie Barra Agoura Learn Brazilian Jiu Jitsu in a top-tier facility, guided by multi-time world champion professors

https://gbagoura.com/contact-us/

Gracie Barra Brazilian Jiu-Jitsu in River – Oaks Texas

GRACIE BARRA RIVER OAKS IN HOUSTON, TEXAS. BRAZILIAN JIU-JITSU & SELF-DEFENSE CLASSES

https://gbriveroaks.com/

Gracie Barra Westchase kids and adults self defense martial arts Houston, Texas

We offer a wide range of kids and adult Jiu-Jitsu classes in Westchase Texas so students can choose the class that best suits their needs

https://gbwestchase.com/

Gracie Barra New Mexico – Jiu Jitsu in Albuquerque

Gracie Barra New Mexico Jiu Jitsu in Albuquerque. JIU-JITSU IS FOR EVERYONE, INCLUDING YOU! BOOK YOUR FREE CLASS OR GET IN TOUCH TODAY

https://gbnewmexico.com/

Gracie Barra Brazilian Jiu-Jitsu in Rio Rancho New Mexico

Gracie Barra Rio Rancho provides Jiu-Jitsu classes for all ages, promoting confidence, discipline, and self-defense

https://gbriorancho.com/

Gracie Barra Jiu-Jitsu West Side Albuquerque New Mexico

Gracie Barra Jiu-Jitsu West Side Albuquerque New Mexico provides classes for all ages, promoting confidence, discipline, self-defense

https://gbwestside.com/

Gracie Jiu-Jitsu Road Northeast Albuquerque New Mexico

Gracie Jiu-Jitsu Road Northeast Albuquerque New Mexico. Brazilian Jiu-Jitsu, BJJ Kids, Self Defense Classes, BJJ Adult, BJJ Women

https://gbalbuquerque.com/

Gracie Brazilian Jiu-Jitsu Santa Ana Califórnia

Gracie Brazilian Jiu-Jitsu Santa Ana Califórnia. Join our Brazilian Jiu-Jitsu Classes. Personal defense, fitness, and a united community

https://gbsantaana.com/

Pousada em Corumbau Jocotoka Village Sul da Bahia

Corumbau no Sul da Bahia, com suas praias intocadas, águas cristalinas e a tranquilidade que só um destino isolado pode proporcionar

https://jocotokacorumbau.com.br/

Cotas do Minas Tênis Clube I, Minas Tênis Clube II, Country e Náutico

Melhores negociações de cotas do principal clubes de Belo Horizonte, o Minas Tênis Clube I, Minas Tênis Clube II, Country e Náutico

https://cotasdominas.com.br/

Compre agora o domínio Araujo Drugstore

Comprar domínio drugstorearaujo.com.br, este domínio exclusivo é ideal para farmácias, redes de drogarias, ou empresas relacionadas à saúde

https://drugstorearaujo.com.br/

Compre agora o domínio Araujo Drugstore

Comprar domínio araujodrugstore.com.br, este domínio exclusivo é ideal para farmácias, redes de drogarias, ou empresas relacionadas à saúde

https://araujodrugstore.com.br/

Dra. Priscila Cartaxo Dermatologista em Belo Horizonte

Clínica de Dermatologia Estética em BH. As mais avançadas tecnologias em tratamentos estéticos, Excelência na saúde e cuidado da pele

https://priscilacartaxodermato.com.br/

DR. FREDERICO CARTAXO – Nutrologia e Medicina do Esporte

Dr. Frederico Cartaxo, médico mais de 14 anos de experiência nas áreas de Clínica Médica, Nutrologia e Medicina do Esporte em Belo Horizonte

https://www.drfredcartaxo.com.br/

As Melhores Baterias Automotivas para Seu Veículo em BH

Aqui você encontra as melhores marcas de baterias automotivas, com garantia do fabricante de até 24 meses. Entrega com instalação grátis em BH!

https://auto.jcbaterias.com.br/

Baterias em BH Para Carros, Socorro Rápido e Instalação Grátis

Baterias em BH Para Carros! Os Melhores Preços Com Pagamento em Até 10X Sem Juros, Entrega e Instalação Grátis, Peça Já (31) 3017-7722

20% Desconto Conta de Luz da Cemig – lis ligth BH MG

20% DESCONTO GARANTIDO NA CONTA DE LUZ DA SUA CASA E DA SUA EMPRESA, Sem Custos com Obras e Investimento Zero

https://descontocontadeluz.com.br/

Construa sua Presença Online com Excelência | Quebrando Tabus

Quebrando Tabus Por Patrícia Quintão: Descubra a sua REAL identidade, prospere na mudança e gere tráfego orgânico para o seu site no Google

https://quebrandotabus.com.br/

Galão – CLUBE ATLÉTICO MINEIRO – Encontre produtos na loja Amazon

CLUBE ATLÉTICO MINEIRO – Encontre produtos na loja Amazon

https://mascaraatleticogalooficial.com.br/

Estúdio Fitburn Brasil

Estúdio mais completo de Belo Horizonte, contamos com profissionais altamente qualificados para o atendimento personalizado

https://www.fitburnbrasil.com.br/

Dr Alysson Resende – Ortodontista e Dentista em BH – Dr Alysson Resende – Ortodontista e Dentista em BH

Dr Alysson Resende dentista atua desde 1999 com excelência nas áreas de ortodontia estética, facetas de porcelana e reabilitação oral, com vasta experiência em ortodontia, próteses e lentes de resina e porcelana, aparelhos Invisalign

https://www.alyssonresende.com.br/

Aparelho Invisalign em BH – Dr Alysson Resende

INVISALIGN é a alternativa quase invisível aos aparelhos ortodônticos convencionais, porque ao invés de movimentar os dentes por meio de peças coladas aos dentes do paciente. Aparelhos Invisaling em BH – Dr Alysson Resende

https://www.querousarinvisalign.com.br/

Lente de Porcelana

Dr. Alysson Resende Ortodontia

https://www.lentedeporcelana.com.br/

ED Amorim – Coquetelaria, Gastronomia, Viagens e Hotéis

É um apaixonado pela coquetelaria, gastronomia, viagens e procura registrar suas experiências com um smartphone e uma lanterninha.Nesta trajetória sempre procurou divulgar os lugares que visitou e as equipes (bares, restaurantes, hotéis, eventos) seja uma simples pastelaria de bairro até um restaurante estrelado Michelin

https://www.edamorim.com.br/

Amorim Garden Espaço de Eventos

Amorim Garden Espaço de Eventos, ambiente charmoso, intimista localizado no coração de Patos de Minas, integrado com a natureza. Casamentos, aniversários, bodas, confraternizações, ensaios fotográficos, vídeos publicitários, festas ou reuniões

https://www.amorimgardeneventos.com.br/

Turbo Brasil – Reparação de componentes diesel

Somos a maior empresa de reparação de componentes diesel da AméricaLatina – Turbo Brasil

https://www.turbobrasil.com.br/

Retifica Tonucci – Retifica de Motores a Diesel

Com um corpo técnico experiente e especializado a Retifica Tonucci realiza uma reforma completa no seu motor diesel

https://www.retificatonucci.com.br/

Turbo Energy Parts Solution Provider

Turbo Energy Parts Solution Provider: serves engineers, retail partsstores, shipping companies among others as distributors of high qualityengine parts and rebuild kitsfor all of the major heavy duty diesel engines

https://www.turboenergyparts.com/

Clínica Melo Concept | Tratamento de varizes, microvarizes em BH

Tratamento de varizes e vasinhos é um procedimento médico, Tratamento de varizes, microvarizes com segurança e conforto

https://clinicamelovascular.com.br/

Êxito – Academia Êxito

https://academiaexito.com.br/

Escritório de Arquitetura CLS em BH

Com estilo contemporâneo, criativo e detalhista, as arquitetas Érika Steckelberg, Graziela Costa e Kivia Costa, uniram suas distintas experiências para criar a CLS Arquitetas Associadas

https://www.cls.arq.br/

SP Inovações Tecnologias Digitais e Formações

SP Inovações Tecnologias Digitais, formação, inovação, qualificação, capacitação, treinamento, eventos e consultoria

https://spinovacoes.com.br/

Gofit Sports – Conectar Clientes a Profissionais de Atividade Física

Gofit Sports, Conectar Clientes a Profissionais de Atividade Física e Esportes de Forma Rápida, Fácil e Segura é o Nosso Negócio

https://gofitsports.com.br/

Doctor G Excelencia Médica: Salud, Bienestar y Longevidad

Cuidamos de ti y de tu familia Excelencia en Salud, Bienestar y Longevidad para la Comunidad Brasileña en EE.UU.

https://doctorgmed.com/es/

Doutor G Excelência Médica: Saúde, Bem-estar e Longevidade

Cuidamos de você e sua família Excelência em Saúde, Bem-Estar e Longevidade para a Comunidade Brasileira nos EUA

https://doctorgmed.com/

Doctor G Medical Excellence: Health Well-being and Longevity

We take care of you and your family Excellence in Health, Well-being and Longevity for the Brazilian Community in the USA

https://doctorgmed.com/en-us/

BTA – Betania Tanure Associados

Consultoria em desenvolvimento empresarial,com foco em cultura, liderança e resultados.

https://betaniatanureassociados.com/

Betania Tanure Associados

BTA – Consultoria em desenvolvimento empresarial,com foco em cultura, liderança e resultados

https://betaniatanureassociados.com/

Casa Cor Minas 2025

A Casa Cor Minas 2025 vem aí para ser memorável! Que tal reviver um pouco da nossa história e de tudo que já construímos nas edições passadas?

https://graziellanicolai.com.br/2025/05/29/casa-cor-minas-2025/

Casa Cor Minas 2025

A Casa Cor Minas 2025 vem aí para ser memorável! Que tal reviver um pouco da nossa história e de tudo que já construímos nas edições passadas?

https://graziellanicolai.com.br/

Gestão e Governança Corporativa – Eight Consultoria

A Eight Consultoria especializada em Gestão e Governança Corporativa implanta soluções na operação do dia a dia da empresa os objetivos e prioridades estratégicas definidos pela Alta Gestão.

https://www.eightconsultoria.com/

Obra de Arte Online

Art gallery market for collectors to acquire original works

The Art Galerie Marketplace is a secure, high-performance platform for museums, collectors, and enthusiasts to acquire original, limited-edition works

Marketplace de Arte

Plataforma exclusiva onde arte e inovação se encontram.

Obras de arte únicas, diretamente para você.

https://obradearte.art.br/

Art Galerie

https://artgalerie.com.br/

Clínica Oftovision – Especialista Oftalmologia – São Paulo

Clínica Oftovision – Especialista Oftalmologia – São Paulo: especialistas na área da oftalmologia, catarata, glaucoma, córnea, uveítes, lentes de contato, retina e mácula, tumores, cirurgia refrativa.

https://oftovision.com.br/

Clínica Oftovision Oftalmologia: São Paulo e Santo André

Clínica Oftovision São Paulo e Santo André: especialistas na área da oftalmologia, catarata, glaucoma, córnea, uveítes, lentes de contato, retina e mácula, tumores, cirurgia refrativa

https://oftovision.com.br/oftovision/

Exames Oftalmológicos: Central de agendamentos: (11) 5181.1110

Clínica Oftovision realiza diversos exames oftalmológicos, os quais auxiliam o médico no diagnóstico correto para um tratamento efetivo

https://oftovision.com.br/exames_oftalmologicos/

Os Convênios da Clínica Oftovision (11) 5181.1110

Os Convênios da Clínica Oftovision: Porto Saúde Fundação Itaú Saúde Omint. Central de agendamentos: (11) 5181.1110

https://oftovision.com.br/convenios/

Blog – Oftovision Oftalmologia

A excelência da Clínica Oftovision direto de São Paulo para o ABC Para você, morador de Mauá, que busca um serviço de saúde ocular confiável

https://oftovision.com.br/blog/

Clínica Oftovision Contato: agendamentos: (011) 5181-1110

Clínica Oftovision: Rua Américo Brasiliense, 1479 – 6º andar – Chácara Santo Antônio, 04715003 São Paulo – SP. | (011) 98367-9797

https://oftovision.com.br/contato/

Reformas prédios residenciais comerciais em BH Construtora FHP

Construtora FHP em Belo Horizonte | Reformas de prédios residenciais e comerciais com qualidade, segurança e durabilidade

https://construtorafhp.com.br/

Soluções Inteligentes em Irrigação para o Agronegócio do Futuro

Wieza Energia

O sistema solar ele não depende da concessionária de energia para ele pode gerar energia direto para um motor ou uma bomba d´agua, funcionando exatamente como um gerador de energia a diesel, porém sem consumir combustível, consumindo apenas a energia vinda do sol.

SOLUÇÕES ENERGÉTICAS

GESTÃO DE ENERGIA

Monitoramos, analisamos e implementamos estratégias de comercialização e consumo inteligente para reduzir custos e aumentar a rentabilidade do negócio